Stability AI携手Arm开源Stable Audio Open Small:手机秒变音频创作利器

文章来源:智汇AI 发布时间:2025-07-04

AI音频生成领域迎来重大突破!近日,Stability AI与芯片巨头Arm强强联手,正式开源专为移动设备打造的Stable Audio Open Small模型。它参数量压缩至341M,能在手机本…

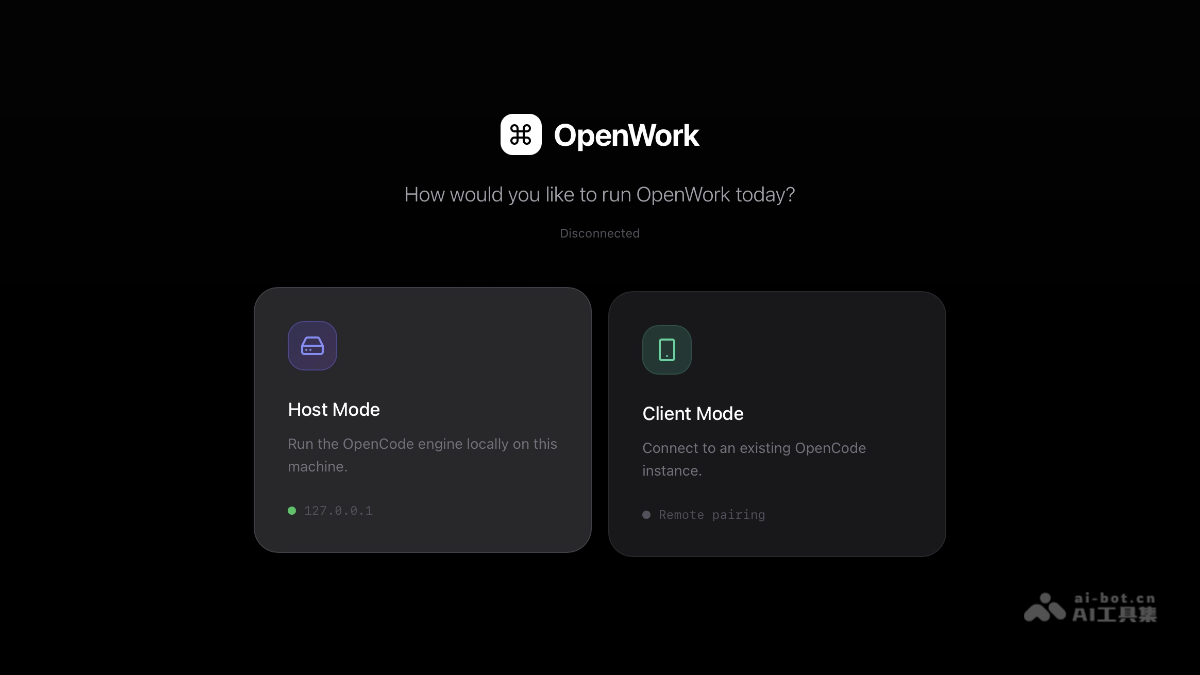

暂无访问StabilityAI与Arm强强联合,开源音频生成新模型StableAudioOpenSmall是什么?

近日,AI领域又有大动作!StabilityAI联合芯片巨头Arm,正式开源了StableAudioOpenSmall。这是一款专为移动设备量身打造的341M参数文本到音频生成模型。它的出现,让AI音频生成技术朝着边缘计算和移动设备大步迈进,意义非凡。

开源地址

模型项目:https://huggingface.co/stabilityai/stable-audio-open-small

技术亮点:深度优化,参数量大幅压缩

StableAudioOpenSmall是在StabilityAI之前发布的StableAudioOpen模型基础上进行深度优化的成果。研发团队通过一系列技术手段,将参数量从1.1B压缩到了341M。这一改变意义重大,大幅降低了模型对计算资源的需求,为在移动设备上运行创造了条件。

Arm助力,移动端快速生成

得益于Arm的KleidiAI库支持,StableAudioOpenSmall展现出了强大的移动端处理能力。在智能手机上,它能在不到8秒的时间内生成最长11秒的44.1kHz立体声音频。

而且,整个生成过程无需云端处理,完全可以在离线场景下完成。这对于那些网络不稳定或者对隐私保护有较高要求的用户来说,无疑是个好消息。

先进架构,文本提示生成音频

该模型采用了潜在扩散模型(LatentDiffusionModel),结合了T5文本嵌入和基于变压器的扩散架构(DiT)。用户只需输入简单的英文文本提示,比如“128BPM电子鼓循环”或者“海浪拍岸的声音”,模型就能生成音效、鼓点、乐器片段或者环境音。经过小编测试,在生成短音频片段时,模型生成的音频细节丰富,非常适合音效设计和音乐制作。

开源与许可:遵循社区许可,免费开放部分用户

StableAudioOpenSmall遵循StabilityAI社区许可。对于研究人员、个人用户以及年收入低于100万美元的企业,模型权重和代码可以免费使用。目前,这些资源已经在HuggingFace和GitHub上发布,方便大家获取和使用。

企业需购许可,确保商业化可持续

而对于大型企业,则需要购买企业许可。这种分级许可策略既降低了技术门槛,鼓励全球开发者积极探索音频生成应用,又能确保技术在商业化过程中的可持续性,实现技术普及与商业发展的双赢。

版权合规,规避潜在风险

值得一提的是,模型训练数据全部来自Freesound和FreeMusicArchive的免版税音频。这一举措确保了版权合规性,有效规避了像Suno和Udio等竞争对手因使用受版权保护内容而引发的风险,让用户使用起来更加安心。

性能与创新:引入ARC方法,提升生成速度

StableAudioOpenSmall引入了对抗性相对对比(ARC)后训练方法。这种方法无需传统蒸馏或无分类器指导,通过结合相对对抗损失和对比鉴别器损失,显著提升了生成速度和提示遵循性。研究显示,在H100GPU上,模型生成12秒音频仅需75毫秒;在移动设备上,大约需要7秒。

性能指标领先,主观评价高分

在性能指标方面,该模型在CLAP条件多样性得分上达到了0.41,位居同类模型之首。在主观测试中,模型在多样性(4.4)、质量(4.2)和提示遵循性(4.2)上均获得了高分,充分展现了其在生成音效和节奏片段方面的优异表现。此外,其Ping-Pong采样技术进一步优化了少步推理,兼顾了速度与质量。

行业意义:转型移动端,覆盖广泛用户

StableAudioOpenSmall的发布标志着AI音频生成技术向移动端和边缘计算的转型。与依赖云处理的竞争对手不同,该模型的离线运行能力为移动场景(如实时音效生成)提供了极大的便利。据统计,它能够覆盖全球99%的智能手机用户,让更多人能够享受到AI音频生成的魅力。

重塑创作生态,促进创意普及

这种技术普及将重塑音频创作生态,让普通用户也能参与到专业级音效设计中来,实现创意的民主化。不过,该模型也存在一些局限性。目前,它仅支持英文提示,对非西方音乐风格的表现较弱,且无法生成逼真的人声或完整歌曲。但StabilityAI表示,未来将优化多语言支持和音乐风格多样性,以提升全球适用性。