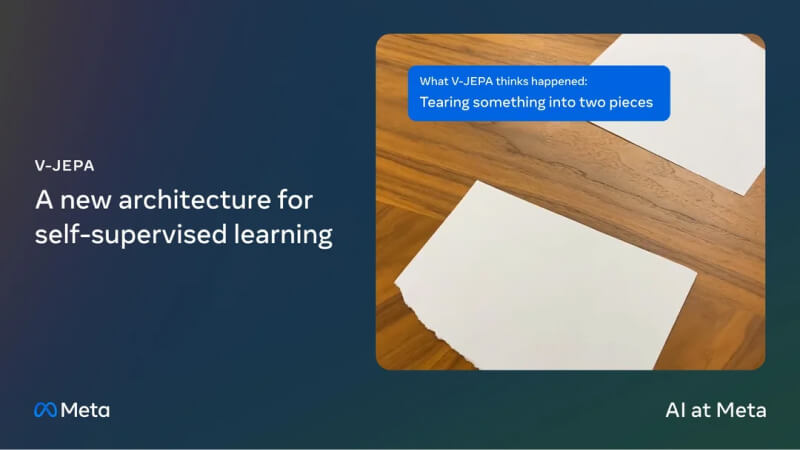

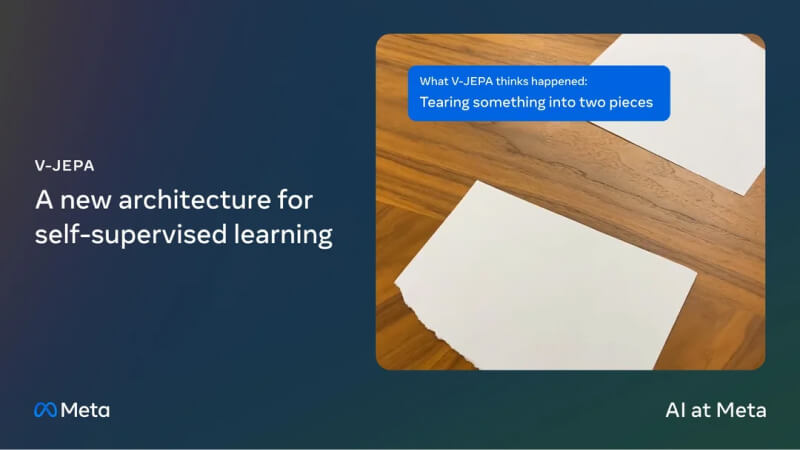

V-JEPA:Meta推出的视觉模型,可以通过观看视频来学习理解物理世界

文章来源:智汇AI 发布时间:2025-08-07

V-JEPA是由Meta的研究人员推出的一种新型的视频自监督学习方法,它专注于通过特征预测来学习视频的视觉表示。这种方法的核心思想是让模型能够预测视频中一个区域

暂无访问V-JEPA是什么?

V-JEPA(Video Joint-Embedding Predictive Architecture,视频联合嵌入预测架构)是由Meta的研究人员推出的一种新型的视频自监督学习方法,它专注于通过特征预测来学习视频的视觉表示。这种方法的核心思想是让模型能够预测视频中一个区域(称为目标区域y)的特征表示,这个预测基于另一个区域(称为源区域x)的特征表示。这种预测过程是在没有外部监督(如标注或预训练图像编码器)的情况下进行的,完全依赖于视频数据本身的结构和内容。

V-JEPA 的与众不同之处在于它的自我监督学习方法,该方法可以预测抽象特征空间内视频的缺失部分,而不是填充缺失像素的生成方法。该技术不是通过手动标注,而是通过像人类一样的被动观察来建立对视频片段的概念理解。

项目介绍:https://ai.meta.com/blog/v-jepa-yann-lecun-ai-model-video-joint-embedding-predictive-architecture/研究论文:https://scontent-hkg1-2.xx.fbcdn.net/v/t39.2365-6/427986745_768441298640104_1604906292521363076_n.pdfGitHub代码库:https://github.com/facebookresearch/jepaV-JEPA的主要特点

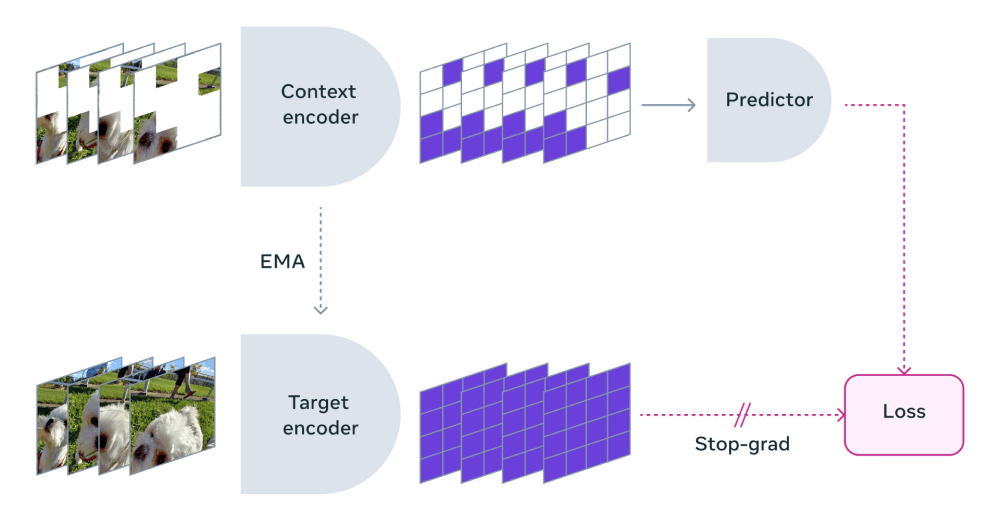

自监督学习:V-JEPA不依赖于预训练的图像编码器、文本、负例、像素级重构或其他形式的外部监督。它完全通过视频数据自身的特征预测来学习视觉表示。特征预测目标:V-JEPA的核心目标是预测视频帧之间的特征表示。这种目标允许模型学习到视频中的时间连续性和空间结构,而不仅仅是像素级别的信息。联合嵌入架构:V-JEPA采用了一种特殊的网络架构,其中包括一个编码器(x-encoder)和一个预测器(predictor)。编码器负责提取视频帧的特征表示,而预测器则基于这些特征来预测目标帧的特征。多块掩蔽策略:在训练过程中,V-JEPA使用多块掩蔽策略来处理视频帧。这种方法通过在视频的不同时间点上掩蔽不同的区域,迫使模型学习到更加鲁棒和全面的视频表示。高效的预训练数据集:V-JEPA在由200万个视频组成的大规模数据集上进行预训练,这些视频来自多个公共数据集,如HowTo100M、Kinetics-400/600/700和Something-Something-v2。无需模型参数调整:V-JEPA训练出的模型在多种下游任务上表现出色,且无需对模型参数进行调整。这意味着模型可以直接在冻结的状态下进行评估,或者通过少量的微调(fine-tuning)来适应新任务。标签效率:V-JEPA在有限的标注数据下也能取得良好的性能,这表明它在标签效率方面具有优势,这对于数据标注成本高昂的场景尤为重要。跨模态性能:V-JEPA不仅在视频任务上表现出色,如动作识别和运动分类,而且在图像任务上也有竞争力,如ImageNet图像分类。快速训练:V-JEPA在训练过程中表现出较高的效率,能够在相对较短的时间内学习到有效的视觉表示,这使得它在大规模视频数据集上的应用成为可能。V-JEPA的工作原理

V-JEPA的工作原理基于自监督学习,它通过预测视频帧之间的特征表示来训练模型。

以下是V-JEPA工作流程的详细步骤:

视频预处理:首先,从输入视频中随机抽取一系列帧(例如16帧),并将这些帧转换为适合模型处理的格式。这通常包括将视频帧的空间分辨率调整到模型所需的大小(如224×224像素),并将帧序列转换为一系列空间-时间(spatio-temporal)的“tokens”。编码器(Encoder):视频帧通过一个视觉Transformer(ViT)编码器,这个编码器将视频帧转换为一系列特征表示。编码器通常由多个Transformer层组成,能够捕捉视频帧之间的空间和时间关系。掩蔽(Masking):在视频帧的特征表示中,随机选择一部分区域进行掩蔽(masking),这些掩蔽的区域将作为预测目标。掩蔽可以是短距离(short-range)或长距离(long-range),以确保模型能够学习到视频内容的不同尺度特征。预测器(Predictor):预测器网络接收编码器输出的特征表示,并尝试预测被掩蔽区域的特征。预测器通常是一个较窄的Transformer,它通过学习视频帧之间的特征关系来生成预测。损失函数:V-JEPA使用一个损失函数来衡量预测特征与实际特征之间的差异。这个损失函数通常是L1损失,它计算预测特征和目标特征之间的平均绝对误差。训练过程:在训练过程中,模型通过反向传播算法调整编码器和预测器的权重,以最小化损失函数。同时,编码器的权重会以指数移动平均(EMA)的方式更新,以保持模型的稳定性。下游任务评估:预训练完成后,V-JEPA模型可以在各种下游任务上进行评估,如动作识别、运动分类等。在这些任务中,模型可以通过一个称为“attentive probe”的轻量级网络来提取视频的特征表示,然后用于分类或其他任务。微调(Fine-tuning):如果需要,V-JEPA模型可以在特定任务上进行微调。这通常涉及到在预训练模型的基础上添加一个或多个全连接层,并在有标签的数据集上进行训练。