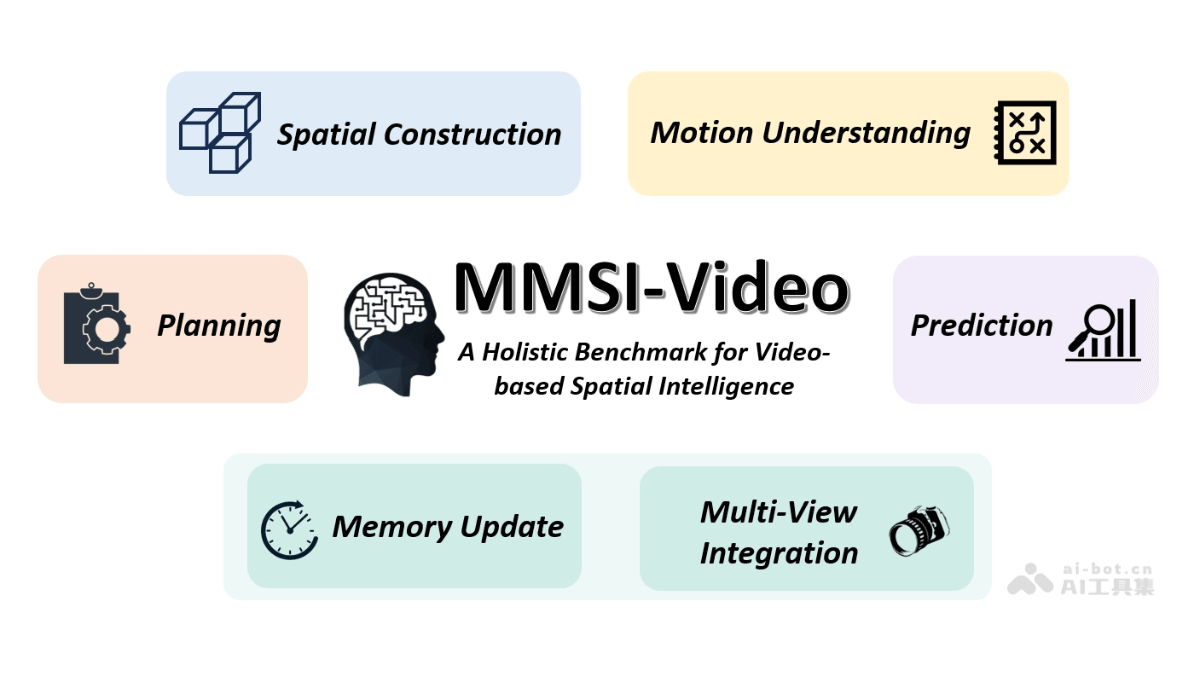

Engram-DeepSeek联合北大推出的条件记忆模块

文章来源:智汇AI 发布时间:2026-01-14

Engram 是DeepSeek团队联合北京大学推出的条件记忆模块,能提升大语言模型(LLM)的性能。Engram通过引入现代化的 -gram 嵌入表,将静态知

暂无访问Engram是什么

Engram 是DeepSeek团队联合北京大学推出的条件记忆模块,能提升大语言模型(LLM)的性能。Engram通过引入现代化的 -gram 嵌入表,将静态知识存储在独立的内存中,用稀疏检索和上下文感知门控技术实现高效的知识查找。Engram 与混合专家模型(MoE)互补,能显著提升模型在知识密集型任务、长上下文处理和推理能力上的表现,不增加计算量,还能突破 GPU 显存限制,支持大规模参数扩展。