AMDAdvancingAI2025大会如期而至:重磅发布InstinctMI350系列GPU产品,推理性能提升达35倍

文章来源:智汇AI 发布时间:2025-06-19

Instinct MI350 系列包括 Instinct MI350X 和 MI355X GPU 及平台,实现了每代 4 倍的 AI 计算能力提升和 35 倍的推理性能飞跃。

暂无访问北京时间6月13日00:30消息,AMDAdvancingAI2025正式开启,AMD董事长兼首席执行官苏姿丰博士同公司高管、AI生态系统合作伙伴、客户、开发人员,共同讨论了AMD的产品和软件将如何发展人工智能生态和高性能计算(HPC)领域的格局。

在本次大会上,AMD全面展示了“端到端”的集成人工智能平台发展愿景,并推出了面向AI的可扩展机架级基础设施产品组合。

首先,AMD推出了全新一代InstinctMI350系列GPU,在生成式人工智能和高性能计算领域实现了性能、能效与可扩展性的全方位提升。

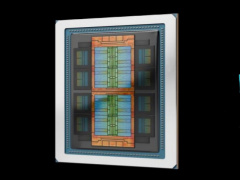

InstinctMI350系列包括MI350X和MI355X2款GPU产品。在性能方面,较上一代产品实现了每代4倍的AI计算能力提升和35倍的推理性能飞跃,此次全新发布的InstinctGPU基于AMDCDNA4架构,3nm制程工艺打造,集成了1850亿个晶体管,支持FP4&FP6新一代AI数据类型,可提供288GBHBM3E显存,支持单GPU上运行高达520B参数的AI模型,支持UBB8行业标准GPU节点,可以帮助企业实现快速部署基础设施。

AMDInstinctMI355XGPU在AI和高性能计算领域都有着出色的表现。据AMD的介绍,在与NVIDIAB200和GB200的对比中,MI355X的显存约为竞品的1.6倍,内存带宽则基本持平。针对FP64和FP32运算,MI355X的峰值性能领先优势达到了竞品的2倍。对于FP16和FP8运算,其峰值性能与竞品相当或略有胜出,而FP6的性能则也达到了竞品2倍以上。此外,在FP4运算上,MI355X与竞品的峰值性能相近。而在性价比方面,另外相比B200,采用InstinctMI355X的企业或开发者可获得40%Tokens/$性价比优势。

相较于上一代的MI300X,MI355X运行Llama3.1405B时,其智能体性能是前者的4.2倍,“内容生成能力”是上一代(MI300X)的2.9倍,“摘要生成”能力是上一代(MI300X)的3.8倍,“对话式人工智能”性能表现则为上一代(MI300X)的2.6倍。

AMDInstinctMI350系列构建基于开放标准的机架级AI基础设施,支持高密度扩展与先进网络互联。

AMDInstinct™MI350系列平台采用开放标准设计,全面支持UEC(UniversalBaseboardforEdgeComputing)与OCP(OpenComputeProject)规范,构建面向下一代AI工作负载的高性能机架级基础设施。该系列结合了InstinctMI350系列加速器与第五代AMDEPYC™x86处理器,支持多种规模配置选项,包括搭载128、96或64颗GPU的系统,分别集成高达36TB、27TB和18TB的HBM3E高带宽内存资源。平台在FP8、FP6和FP4等多种精度下均具备卓越的AI运算能力,可满足大规模模型训练、推理与部署需求,特别适用于超大规模数据中心与云端AI集群的横向扩展。相关系统方案预计将于2025年第三季度起,通过AMD合作伙伴生态体系全面推出。

AMD预告下一代AI机架架构“Helios”,引领未来高性能计算基础设施发展

在AdvancingAI2025活动上,AMD预告了其下一代机架级AI系统架构“Helios”,该架构将集成多项先进计算组件,进一步拓展高性能AI基础设施的边界。Helios架构将采用即将发布的AMDInstinctMI400系列GPU、基于“Zen6”微架构的AMDEPYC“Venice”处理器,以及AMDPensando“Vulcano”智能网卡,构建具备高带宽、高互联与高能效特性的开放式平台,旨在满足下一代大规模AI模型的训练与部署需求。

AMD预览下一代“Helios”机架级AI架构,搭载InstinctMI400加速器与Zen6平台,面向2026年全面部署、

与此同时,AMD也向大家预览了InstinctMI400系列加速器的核心规格,该系列预计将于2026年正式推出。MI400将配备高达432GB的HBM4高带宽显存,实现19.6TB/s的显存带宽与每卡300GB/s的扩展互联带宽。在AI运算能力方面,MI400系列提供高达40PFLOPS(FP4精度)和20PFLOPS(FP8精度)的峰值性能,进一步巩固AMD在生成式AI和高性能计算领域的技术领先地位,延续MI300X与MI325X平台在能效、规模与灵活性方面的优势。

全新ROCm7发布!助力开发效率提升,加速AI应用落地

在硬件产品稳步发展的同时,最新版本的AMD开源AI软件栈ROCm7也受到了科技行业和开发者们的关注。全新的ROCm7其旨在满足生成式人工智能和高性能计算工作负载不断增长的需求。并在整体功能与生态兼容性上实现全面增强。新版本带来对主流行业标准AI框架的更强支持,显著扩展硬件适配范围,并引入全新开发工具链、驱动程序、API与加速库,进一步优化开发者体验,加速AI应用的开发、调试与部署流程。

AMDDeveloperCloud面向全球开发者全面开放,助力高效AI开发与无缝扩展

最后,AMD宣布将进一步扩大AMDDeveloperCloud的可用性,面向全球开发者与开源社区开放访问权限。该平台专为快速、可扩展的高性能AI开发而打造,提供完全托管的云端环境,集成丰富的开发工具与资源,支持用户快速启动AI项目并实现灵活扩展,满足从原型验证到大规模部署的全流程需求。通过AMDDeveloperCloud搭配ROCm™7软件栈,AMD正在持续降低AI计算门槛,加速创新落地。

智汇AI6月13日消息,AMD在北京时间今日凌晨00:30举办了其年度人工智能直播活动AdvancingAI2025,AMD董事长兼首席执行官苏姿丰同其它高管以及AI生态系统合作伙伴、客户、开发人员一起,共同讨论了AMD的产品和软件如何重塑AI和高性能计算(HPC)格局。

在本次大会上,AMD展示了其全面的端到端集成人工智能平台愿景,并推出了全新基于行业标准的开放、可扩展的机架级人工智能基础设施产品。

首先,AMD推出了全新一代InstinctMI350系列GPU,在生成式人工智能和高性能计算的性能、效率和可扩展性方面得到全面提升。

InstinctMI350系列包括InstinctMI350X和MI355XGPU及平台,实现了每代4倍的AI计算能力提升和35倍的推理性能飞跃。

新的GPU基于AMDCDNA4架构,3nm制程工艺打造,集成了1850亿个晶体管,支持FP4&FP6新一代AI数据类型,可提供288GBHBM3E显存,支持单GPU上运行高达520B参数的AI模型,支持UBB8行业标准GPU节点,提供风冷和直液冷两种版本,可以帮助企业实现快速部署基础设施。

AMDInstinctMI355XGPU在AI和HPC领域性能有出色表现,根据AMD的介绍,在与NVIDIAB200和GB200的对比中:

在内存容量方面,MI355X约为竞品的1.6倍,内存带宽则基本持平。

针对FP64和FP32运算,MI355X的峰值性能接近竞品的两倍。

对于FP16和FP8运算,其峰值性能与竞品相当或略高,FP6性能则达到2倍以上。

在FP4运算上,MI355X与竞品的峰值性能相近,小幅领先。

另外相比B200,使用InstinctMI355X可获得40%Tokens/$性价比提升。

而在和上一代MI300X的对比中,MI355X运行Llama3.1405B模型,在AI智能体性能表现上是前者的4.2倍,内容生成能力是上一代MI300X的2.9倍,摘要能力是上一代的3.8倍,对话式人工智能表现则为2.6倍。

AMD表示,InstinctMI350系列超出了AMD设定的五年目标,即将AI训练和高性能计算节点的能效提高30倍,最终实现了38倍的提升。

AMDInstinctMI350系列提供基于开放标准的机架基础设施和网络解决方案。

该系列产品支持UEC、OCP设计,搭载InstinctGPU与第五代EPYCx86CPU,不同配置包括128颗GPU、96颗GPU和64颗GPU,分别具备36TB、27TB和18TBHBM3E内存,性能指标涵盖FP8、FP6和FP4精度,适用于大规模机架扩展方案,预计从Q3开始通过AMD解决方案合作伙伴提供相关产品。

智汇AI从活动获悉,AMD还预告了其下一代AI机架架构“Helios”。它将基于下一代AMDInstinctMI400系列GPU、基于“Zen6”架构的AMDEPYC“Venice”CPU以及AMDPensando“Vulcano”网卡构建。

同时AMD更预告了InstinctMI400系列GPU,预计2026年上市。该系列配备432GBHBM4显存,带宽达19.6TB/s,每GPU扩展带宽为300GB/s;提供40PFFP4和20PFFP8的AI计算性能,延续MI300X、MI325X等系列优势。

AMD还公布了一个新的2030年目标,即从2024年基准年起,将机架级能效提高20倍,届时,现在需要超过275个机架才能训练的典型AI模型,在2030年时仅需一个完全利用的机架即可完成训练,同时耗电量减少95%。

此外最新版本的AMD开源AI软件栈ROCm7也受到了不少网友的关注,其旨在满足生成式人工智能和高性能计算工作负载不断增长的需求——同时全面提升开发者体验。ROCm7具有改进的行业标准框架支持、扩展的硬件兼容性以及新的开发工具、驱动程序、API和库,以加速AI的开发和部署。

最后值得一提的是,AMD将为面向全球开发者和开源社区的AMD开发者云带来更广泛的使用权限。该平台专为快速、高性能的AI开发而构建,用户在AMD开发者云上将能够访问一个完全托管的云环境,包括拥有启动AI项目所需的工具和灵活性,并能够无限制扩展。