DragonV2.1是什么

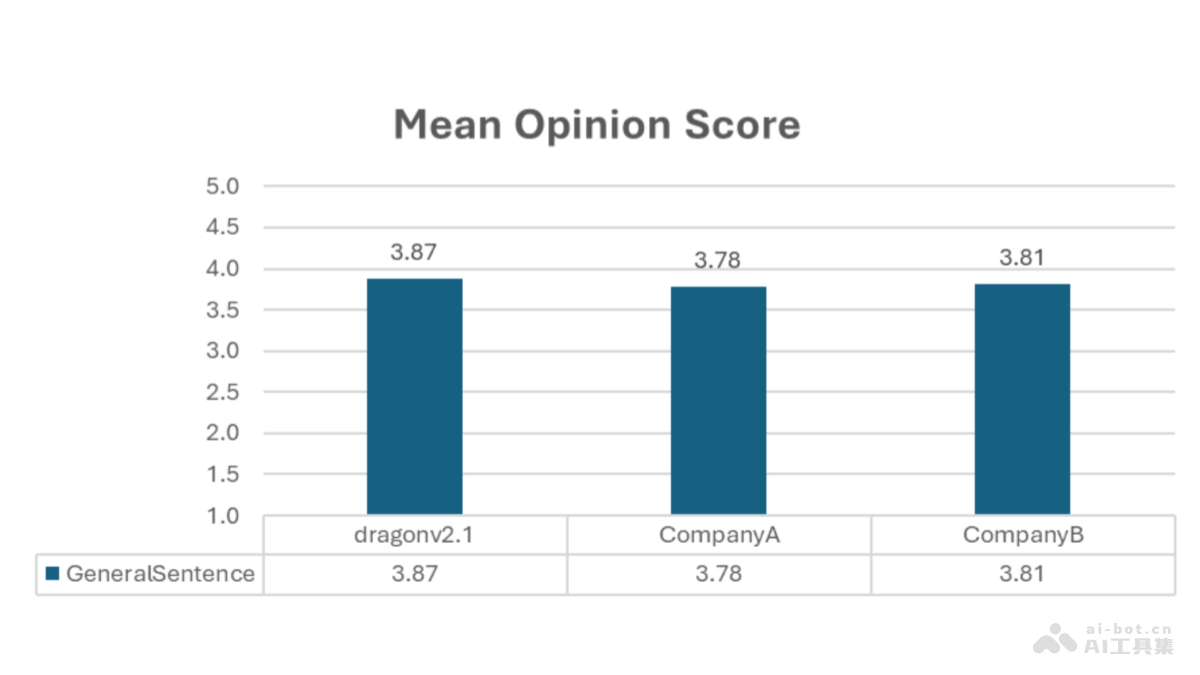

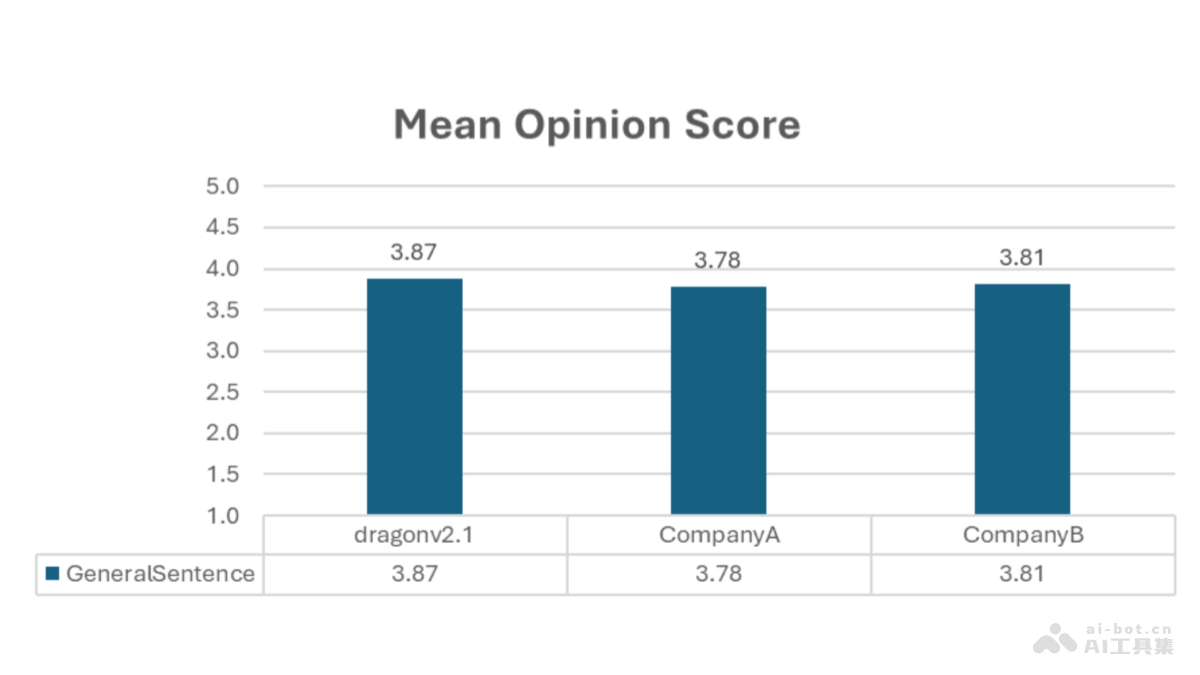

DragonV2.1(DragonV2.1Neural) 是微软推出的最新零样本文本到语音(TTS)模型。模型基于 Transformer 架构,支持多语言和零样本语音克隆,仅需 5-90 秒的语音提示即可生成自然、富有表现力的语音。模型在发音准确性、语音自然度和可控性方面进行显著改进, 与DragonV1 相比,模型单词错误率(WER)平均降低 12.8%,支持 SSML 音素标签和自定义词典,能精确控制发音和口音。模型集成水印技术,确保语音合成的合规性和安全性。

DragonV2.1的主要功能

多语言支持:支持 100 多种 Azure TTS 语言环境,支持合成多种语言的语音,满足不同用户的需求。情感和口音适应:根据上下文调整语音的情感和口音,让语音更具表现力和个性化。零样本语音克隆:仅需 5-90 秒的语音提示,能快速生成用户自己的 AI 语音副本,大大降低语音克隆的门槛。快速生成:能在短时间内生成高质量的语音合成结果,延迟小于 300 毫秒,实时因子(RTF)小于 0.05,适合实时应用场景。发音控制:支持使用 SSML(语音合成标记语言)中的音素标签,用户能通过国际音标(IPA)音素标签和自定义词典精确控制语音的发音。自定义词典:用户能创建自定义词典,定义特定词汇的发音方式,确保语音合成的准确性。语言和口音控制:支持多种语言和特定口音的生成,例如英式英语(en-GB)、美式英语(en-US)等。水印技术:自动生成的语音输出中自动添加水印,有效防止语音合成内容的滥用。

DragonV2.1的技术原理

Transformer 架构:DragonV2.1 基于 Transformer 模型架构,广泛应用在自然语言处理和语音合成的深度学习架构。Transformer 基于自注意力机制(Self-Attention)处理输入数据,能捕捉长距离的依赖关系,生成更自然、更连贯的语音。多头注意力机制:Transformer 中的多头注意力机制支持模型从不同角度关注输入数据的不同部分,提高模型对语音特征的捕捉能力。SSML 支持:SSML 是用于描述语音合成的标记语言,DragonV2.1 支持 SSML 中的音素标签和自定义词典。用户能通过 SSML 精确控制语音的发音、语调、节奏等,确保语音合成的准确性和自然度。

DragonV2.1的项目地址

项目官网:https://techcommunity.microsoft.com/blog/azure-ai-services-blog/personal-voice-upgraded-to-v2-1-in-azure-ai-speech-more-expressive-than-ever-bef/4435233

DragonV2.1的应用场景

视频内容创作:为视频生成多语言配音和实时字幕,保留原始演员的语音风格,提升全球观众的观看体验。智能客服与聊天机器人:生成自然、富有表现力的语音回复,支持多语言,提升用户体验,降低客服成本。教育与培训:生成多种语言的语音,帮助语言学习者练习发音和听力,增强在线课程的互动性。智能助手:为智能家居设备和车载系统提供自然语音交互,支持多语言,提升用户便利性。企业与品牌:创建品牌语音,用于广告和市场推广,支持多语言,提升品牌识别度和全球市场覆盖。