微软开源手机视觉交互智能体:基于GPT-4V

近日,微软公司宣布开源一个针对智能手机UX自动化交互的GUI项目「OmniParser」,是一款解析和识别屏幕上可交互图标的 AI 工具。

传统的自动化方法通常依赖于解析 HTML 或视图层次结构,从而限制了其在非网络环境中的适用性。 而包括 GPT-4V 在内的现有的视觉大语言模型(VLMs),并不擅长解读复杂 GUI 元素,导致动作定位不准确。

为了解决这个难题,微软研究人员开源了纯视觉 GUI 智能体「OmniParser」,能够轻松将用户界面截图解析为结构化元素,显著增强OpenAI的 GPT-4V 等视觉模型对智能终端操作界面的区域预测能力。目前,OmniParser开源后在Github上非常火,已经得到了开发者多达3800颗星点赞。

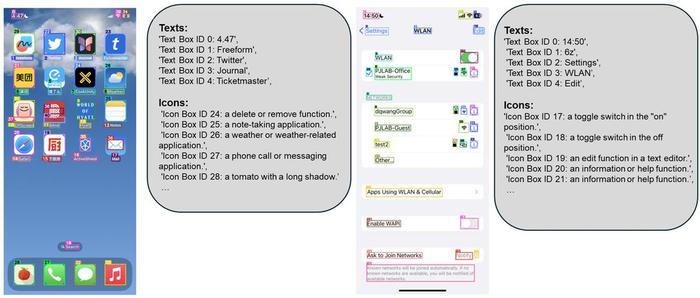

OmniParser的核心组件包括一个微调的交互式图标检测模型、一个微调的图标描述模型以及OCR光学字符识别模块。

在多个基准测试结果显示,GPT-4V在与OmniParser集成后性能得到显著提升,超过同类模型。