Video-R1:香港中文大学和清华大学联合推出的全球首个视频版R1模型

Video-R1是什么?

Video-R1是由香港中文大学和清华大学联合推出的全球首个视频版R1模型,它可以通过强化学习提升多模态大语言模型(MLLMs)的视频推理能力。

Video-R1功能

时间感知推理:Video-R1引入了T-GRPO算法,通过对比乱序输入和顺序输入的视频帧,鼓励模型利用时间信息进行推理,从而更好地理解视频中的时序关系。

混合数据训练:为解决高质量视频推理数据稀缺的问题,Video-R1采用图像和视频混合数据集进行训练,包括Video-R1-COT-165k(用于SFT冷启动)和Video-R1-260k(用于RL训练),使模型能够从静态图像推理能力迁移到动态视频推理。

多种输出类型:Video-R1支持多种答案输出类型,包括多项选择、数值、OCR、自由形式和回归等。

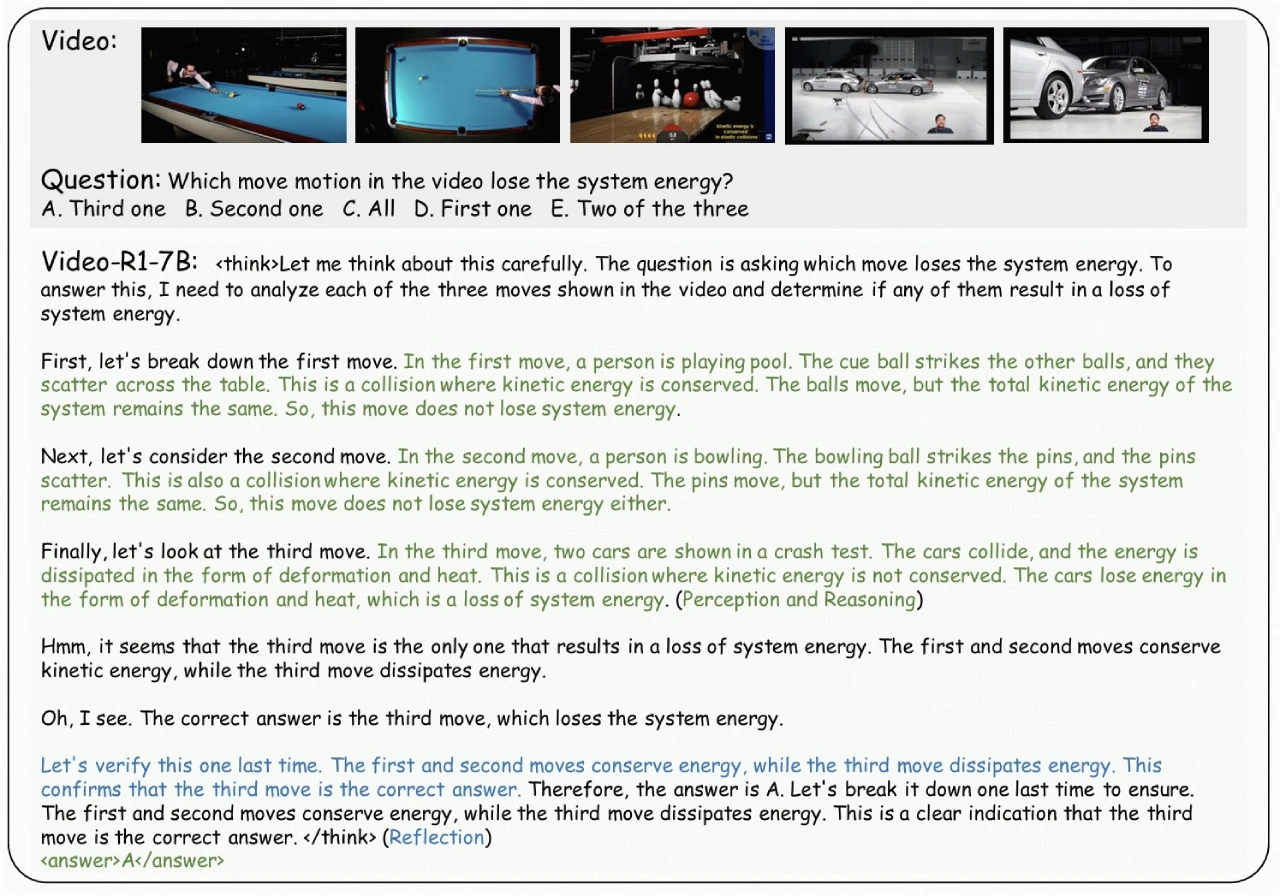

自我反思推理行为:模型在推理过程中会进行自我反思,调整推理方向以得出更准确的结论,这种“啊哈时刻”表明模型在积极进行内部反馈循环。

Video-R1技术

时间感知算法T-GRPO:该算法增强了模型对时间序列的理解能力,使模型能够深度思考事件之间的因果关系。与传统GRPO算法相比,T-GRPO通过奖励机制绑定时间理解,让模型在顺序输入上答对题的比例更高时才会获得奖励。

混合图像视频数据集:研究人员创建了两个高质量数据集:Video-R1-COT-165k(以图像为主)和Video-R1-260k(以高质量视频为核心),解决了视频推理数据稀缺的问题。这种混合训练方式让模型从“看图说话”进化到“视频深思”,真正实现了多模态理解。

强化学习训练策略:Video-R1通过强化学习训练,模型在训练过程中逐渐抛弃次优推理模式,形成更高效、更具逻辑的表达路径。

Video-R1应用

视频内容分析:Video-R1能够对视频中的动态内容进行高效解析和理解,可用于自动生成关键视频片段、行为识别、智能标签生成等功能。

视频搜索与推荐:通过深度推理,Video-R1可以更精准地理解用户需求,提供更符合用户兴趣的视频内容推荐。

自动驾驶视觉理解:模型能够理解视频中的时序关系和因果逻辑,有助于自动驾驶系统更好地感知和预测道路环境。

视频监控与安全:Video-R1可以用于监控视频的实时分析,快速识别异常行为或事件,提升公共安全。

教育与培训:在教育领域,Video-R1可以用于智能辅导系统,通过分析教学视频内容,为学生提供个性化的学习建议。

智能家居:模型可以集成到智能家居系统中,通过视频分析实现更智能的环境感知和自动化控制。

GitHub 地址:https://github.com/tulerfeng/Video-R1

论文:https://arxiv.org/abs/2503.21776