aniportrait怎么用

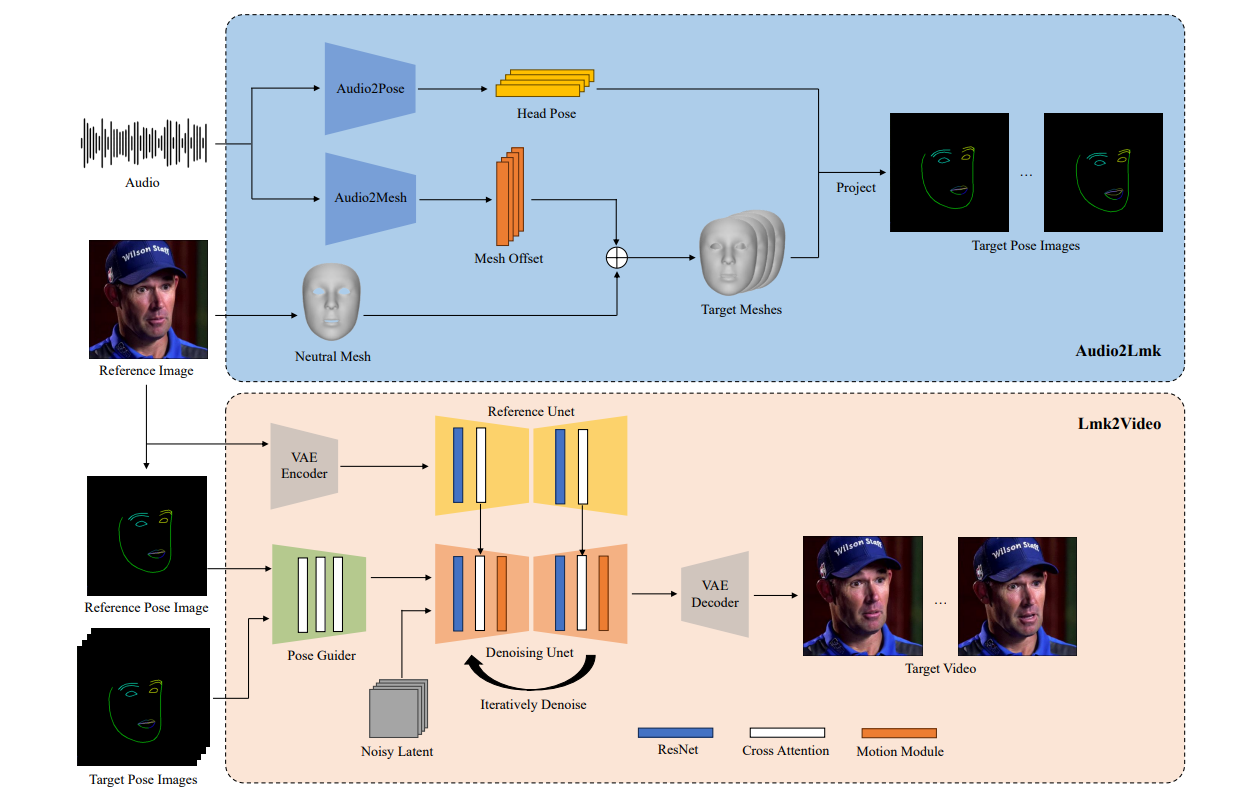

AniPortrait是由腾讯研究人员开发的一款创新的音频驱动肖像动画合成框架,它能够将静态的肖像图像转化为随着音频移动的动态图像。以下是使用AniPortrait的详细步骤:

一、环境准备

- 安装Python:

- 推荐使用Python 3.10版本,因为AniPortrait可能依赖于此版本的某些特性或库。

- 安装CUDA:

- CUDA 11.7或更高版本是推荐的,因为它可以加速深度学习模型的训练和推理。

- 克隆项目:

- 使用Git克隆AniPortrait的GitHub仓库到本地计算机。

- 安装依赖库:

- 运行

pip install -r requirements.txt命令安装所有必需的Python依赖库。

- 运行

- 下载预训练权重:

- 从项目提供的链接或指定位置下载预训练权重文件,并将它们放置在

./pretrained_weights目录下。

- 从项目提供的链接或指定位置下载预训练权重文件,并将它们放置在

二、配置与使用

- 修改配置文件:

- 根据需要修改配置文件(如

animation.yaml),指定权重文件的路径、输入音频和参考图像的路径等。

- 根据需要修改配置文件(如

- 运行框架:

- AniPortrait提供了多种命令行工具来支持不同的动画生成需求。

- 自我驱动动画:使用

pose2vid脚本,通过指定动画配置文件和加速参数来生成视频。 - 面部再现:使用

vid2vid脚本,添加源面部视频和参考图像来生成面部动画。 - 音频驱动动画:使用

audio2vid脚本,在配置文件中添加音频和参考图像后生成音频驱动的视频动画。

- 命令示例:

- 自我驱动动画生成命令示例:

python -m scripts.pose2vid --config ./configs/prompts/animation.yaml -W 512 -H 512 -acc - 面部重演命令示例:

python -m scripts.vid2vid --config ./configs/prompts/animation_facereenac.yaml -W 512 -H 512 -acc - 音频驱动动画生成命令示例:

python -m scripts.audio2vid --config ./configs/prompts/animation_audio.yaml -W 512 -H 512 -acc

- 自我驱动动画生成命令示例:

三、注意事项

- 输入质量:

- 确保输入的音频和参考图像质量良好,以获得最佳的动画效果。

- 硬件要求:

- 由于AniPortrait使用了深度学习模型,因此建议使用具有足够显存的GPU来加速训练和推理过程。

- 参数调整:

- 可以根据需求调整配置文件中的参数,如视频分辨率、加速参数等,以获得更好的性能或效果。

- 逐步尝试:

- 对于初次使用AniPortrait的用户,建议从简单的命令和配置开始,逐步熟悉框架的功能和用法。

通过以上步骤,您应该能够成功地使用AniPortrait框架来生成音频驱动的肖像动画。如果遇到任何问题或需要进一步的帮助,请查阅项目的官方文档或社区论坛以获取更多信息。